「你知道公司內部用了多少 AI 工具嗎?」資安新創Harmonic揭露影子AI危機

- 發布單位:TWCERT/CC

- 更新日期:2025-06-23

- 點閱次數:26712

隨著生成式人工智慧(GenAI)在企業內部的應用迅速擴展,資安團隊面臨前所未有的挑戰。企業除了滿足業務部門加快採用AI工具的需求外,更需嚴格控管隨之而來的資安風險,尤其是敏感資料外洩與合規問題。

目前企業常見的AI風險包括:

- 機密資料被納入其他公司模型訓練中

- 資料流向地緣政治敏感地區

- 員工使用未經授權的AI應用程式

近期案例顯示,一家銀行內部員工使用超過50種未經批准的AI工具,僅有2種獲得公司授權;另一家科技公司工程師甚至將400GB資料上傳至未授權平台。更有新進員工在完成資安訓練後,將原始碼上傳至中國所屬大型語言模型平台。

企業目前嘗試多種控管措施,但仍面臨挑戰:

- 制定AI使用政策:多數公司已有AI使用政策,但員工閱讀率低,更有趣的是,有些政策本身是用ChatGPT所撰寫,實效有限。

- 成立AI指導委員會:形式上看似完整但缺乏可視性,難以有效監督。

- 資料分類管理:利用Microsoft Purview等工具進行資料標記與分類,但在大規模環境中實施困難。

- 統一AI工具平台:約70%企業推行統一平台(如Microsoft Copilot、Google Gemini),但員工常繞過限制,造成資安與業務部門對立。

- 放任模式 (YOLO Mode):約30%企業僅封鎖高風險工具,對其採取「眼不見為淨」的策略。

Harmonic Security 執行長 Alastair Paterson 建議企業應從「禁止」走向「安全引導使用」,並提出三大核心建議:

- 瀏覽器端的即時監控:透過瀏覽器擴充套件,即時偵測使用者在AI工具中輸入的提示詞(Prompt)與上傳的附件(如Excel、PDF),有效掌握風險內容。

- 多樣化的模型管控與策略:針對不同敏感資料類型,導入經微調的開源模型(如LLaMA、Mixtral),在成本可控下提升偵測準確度。

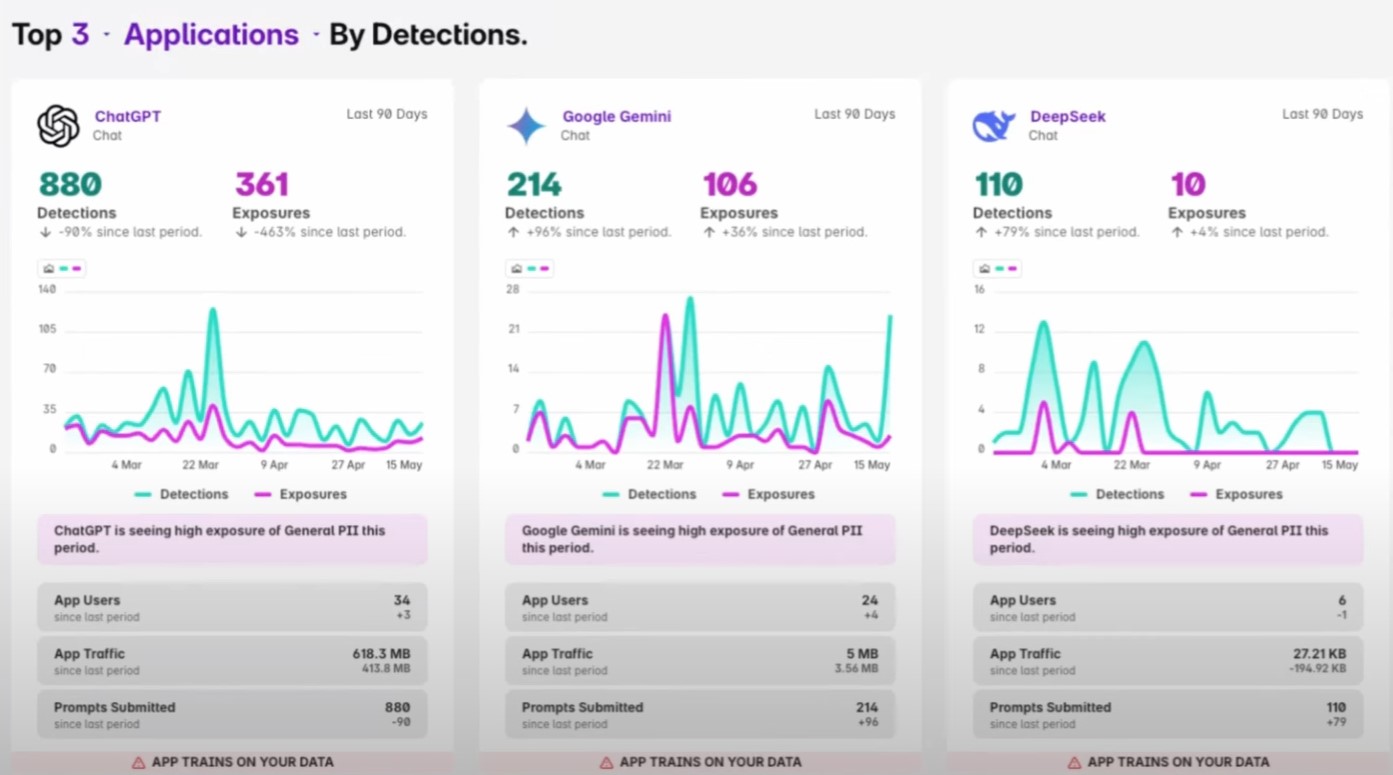

- 可視化儀表板與行為分析:建立全方位儀表板,協助資安團隊掌握 AI 工具使用狀況,進行風險評估與異常行為分析。

圖1:視覺化範例。圖片來源:Harmonic Security的展示影片

隨著生成式AI工具持續深入企業日常營運,資安團隊必須從傳統的防堵思維轉型為前瞻性風險治理。唯有結合即時監控、彈性策略與可視化分析,企業才能在追求創新效率的同時,有效控管潛藏的資安威脅,保障企業資訊安全的合規。